Alors que les assistants IA s'intègrent à une vitesse fulgurante dans notre quotidien, une enquête d'envergure tire la sonnette d'alarme : la plupart de ces outils fonctionnent dans une quasi-opacité, dissimulant les données essentielles à l'évaluation de leur sûreté.

L'utilisation des intelligences artificielles s'est généralisée, allant de la simple planification de repas à l'automatisation de tâches complexes en entreprise. Ces systèmes, conçus pour agir de manière de plus en plus autonome, s'appuient sur des modèles fondamentaux comme GPT, Claude ou Gemini.

L'utilisation des intelligences artificielles s'est généralisée, allant de la simple planification de repas à l'automatisation de tâches complexes en entreprise. Ces systèmes, conçus pour agir de manière de plus en plus autonome, s'appuient sur des modèles fondamentaux comme GPT, Claude ou Gemini.Cependant, cette adoption massive se heurte à une problématique de fond : un déficit flagrant de communication sur les protocoles de sécurité qui les encadrent, un enjeu mis en lumière par le récent rapport AI Agent Index de 2025.

Alors que leurs capacités sont largement vantées, les informations cruciales sur leur sécurité et leurs risques sont systématiquement occultées par les développeurs, créant une asymétrie d'information préoccupante pour les utilisateurs et les régulateurs.

Un décalage alarmant entre capacités et transparence

L'étude, qui a analysé trente des agents IA les plus avancés du marché américain et chinois, met en évidence ce que les chercheurs nomment une "asymétrie de la transparence".

Les développeurs communiquent abondamment sur les performances et les nouvelles fonctionnalités, mais restent extrêmement discrets sur les évaluations de risques.

Le constat est sans appel : seuls quatre agents sur trente publient des documents de sécurité formalisés, les fameuses "system cards", qui détaillent leur niveau d'autonomie et les analyses de risques.

Cette rétention d'information est quasi systématique. Vingt-cinq des agents étudiés ne divulguent aucun résultat de leurs tests de sécurité internes, et vingt-trois ne fournissent aucune donnée issue d'évaluations par des tiers indépendants.

Cette rétention d'information est quasi systématique. Vingt-cinq des agents étudiés ne divulguent aucun résultat de leurs tests de sécurité internes, et vingt-trois ne fournissent aucune donnée issue d'évaluations par des tiers indépendants.Ce manque de preuves empiriques empêche toute analyse rigoureuse des dangers potentiels, notamment concernant les vulnérabilités aux injections de prompts malveillants, une technique permettant de contourner les garde-fous d'une IA.

Les agents navigateurs et d'entreprise, zones grises de l'autonomie

Le rapport identifie une catégorie d'agents particulièrement préoccupante : les navigateurs web augmentés par l'IA. Conçus pour agir sur internet au nom de l'utilisateur, ils peuvent cliquer, remplir des formulaires ou effectuer des achats.

Ce sont eux qui présentent les plus hauts niveaux d'autonomie, mais aussi les plus grands manques d'information, avec 64 % des champs liés à la sécurité non renseignés.

Pire encore, certains sont explicitement conçus pour imiter le comportement humain afin de contourner les protections anti-bots. Les agents destinés aux entreprises ne sont pas en reste, affichant un taux d'opacité de 63 %.

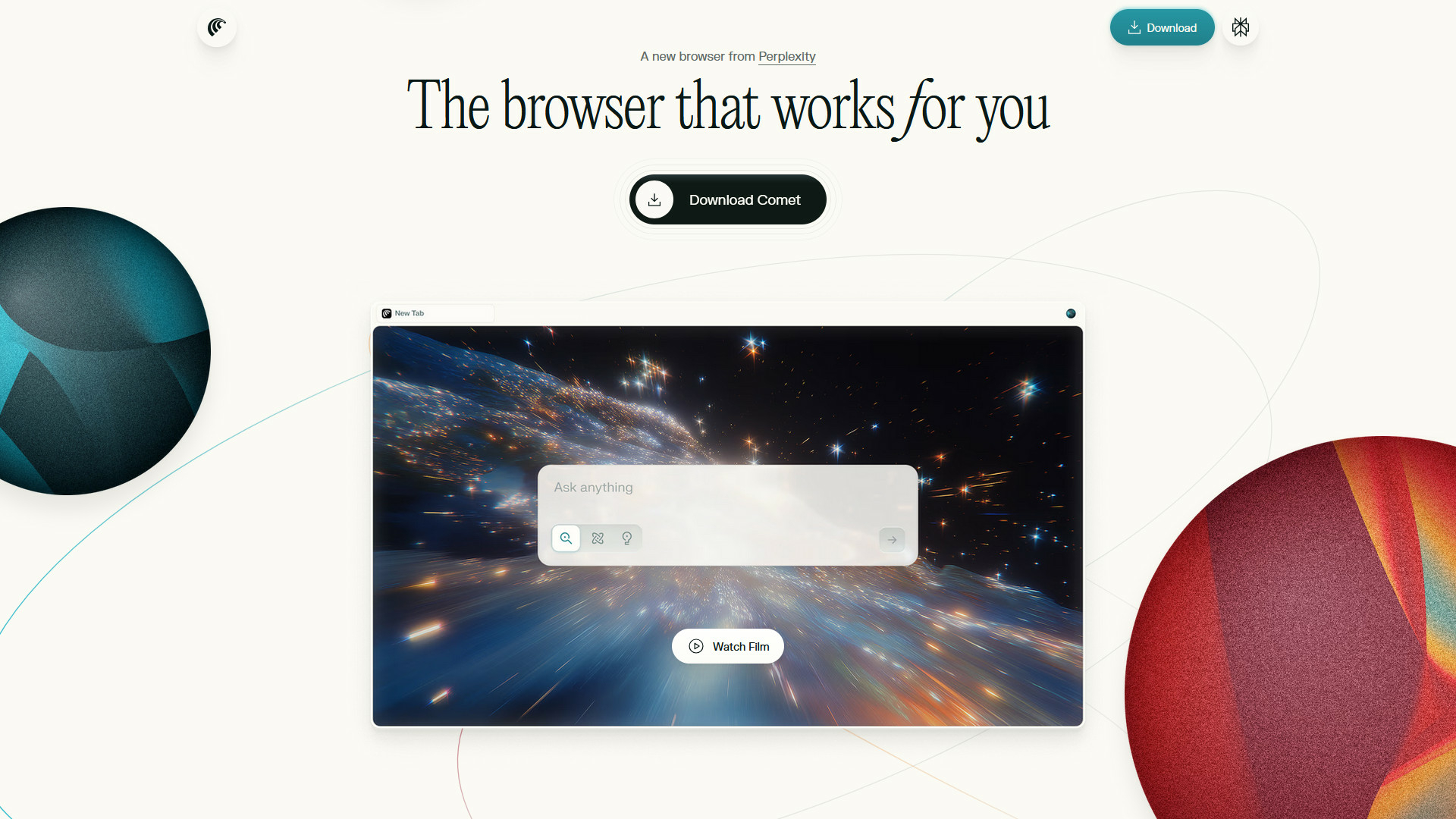

Le cas de Perplexity Comet est emblématique. Présenté comme un "assistant humain", il a déjà fait l'objet de menaces juridiques pour ne pas avoir révélé sa nature d'IA lors d'interactions avec des services tiers.

Le cas de Perplexity Comet est emblématique. Présenté comme un "assistant humain", il a déjà fait l'objet de menaces juridiques pour ne pas avoir révélé sa nature d'IA lors d'interactions avec des services tiers.Sans garde-fous clairs, ces outils exposent les utilisateurs à des risques d'exploitation de failles de sécurité aux conséquences potentiellement immédiates et étendues.

Une dépendance systémique et des responsabilités diluées

L'enquête révèle également une forte concentration du marché. En dehors de la Chine, la quasi-totalité des agents repose sur une poignée de modèles fondateurs (GPT, Claude, Gemini).

Cette dépendance partagée crée des points de défaillance uniques à l'échelle de l'écosystème. Une faille de sécurité ou une interruption de service sur un seul de ces modèles pourrait avoir des répercussions en cascade sur des centaines d'outils qui en dépendent.

Les chercheurs soulignent que les développeurs se contentent souvent de mentionner la sécurité du modèle de langage sous-jacent, en omettant les comportements émergents propres à l'agent lui-même, qui découlent de sa mémoire, de ses outils et de ses politiques d'action.

Alors que ces systèmes deviennent capables d'agir directement dans le monde réel, l'absence de cadres de gouvernance et de transparence solides laisse un vide dangereux, posant la question urgente de la mise en place de standards de divulgation obligatoires pour l'avenir.

merci à GNT