Une étude choc publiée dans la revue Nature Medicine révèle que ChatGPT Health, l'outil santé d'OpenAI, se trompe lourdement dans l'évaluation des urgences. L'intelligence artificielle conseille de patienter dans plus d'un cas sur deux nécessitant une intervention médicale immédiate, exposant des millions d'utilisateurs à des dangers bien réels.

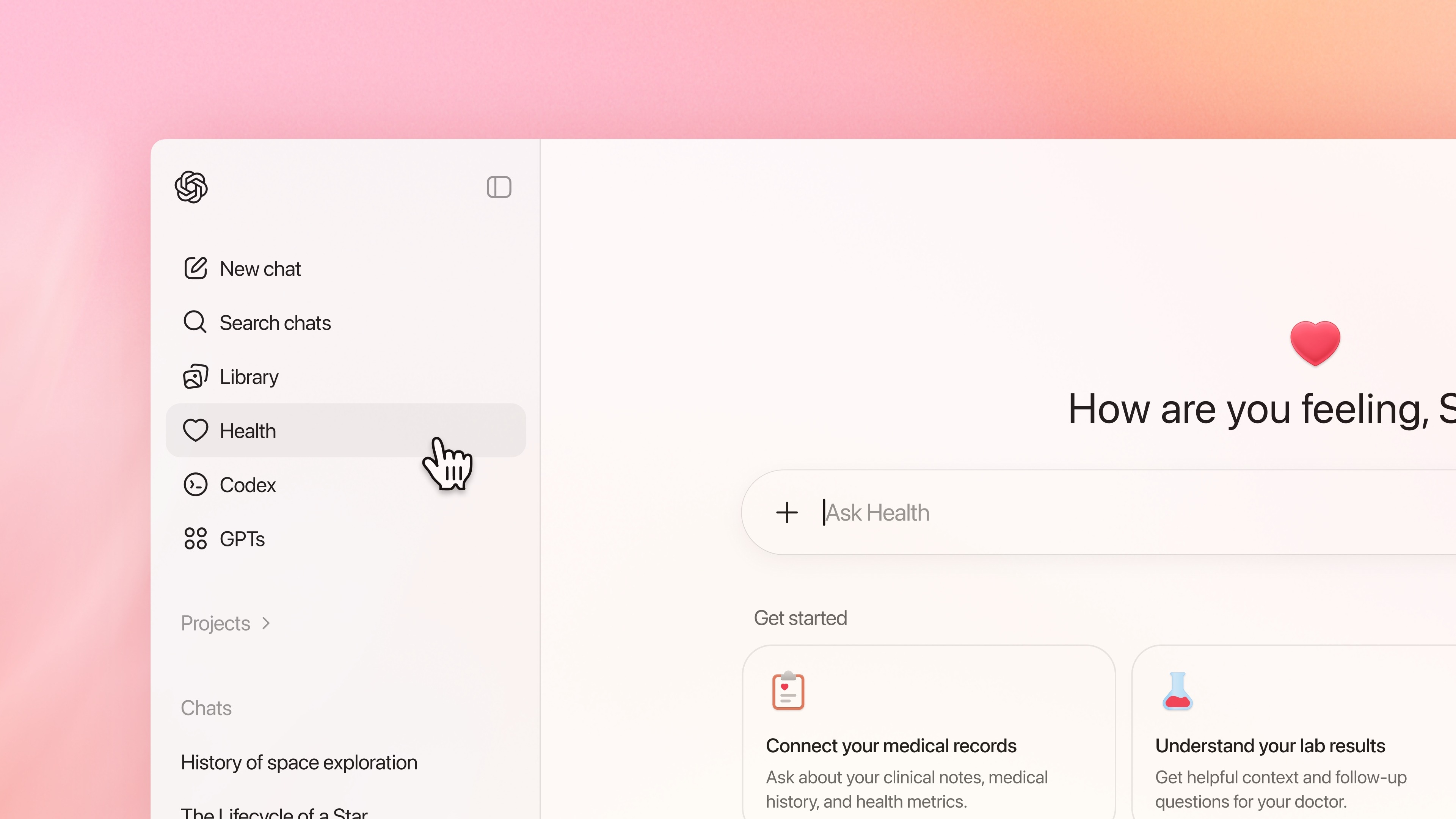

Lancé en janvier 2026, l'outil santé d'OpenAI a rapidement séduit des dizaines de millions d'utilisateurs quotidiens, tous en quête de réponses à leurs inquiétudes médicales. Mais la première évaluation de sécurité indépendante, menée par des chercheurs de l'Icahn School of Medicine at Mount Sinai à New York, dresse un portrait glacial de ses capacités. En soumettant 60 scénarios cliniques variés à l'IA, les experts ont comparé ses recommandations à celles d'un consensus de médecins. Le résultat est un échec cuisant, qui soulève de profondes questions sur la régulation de ces technologies algorithmiques.

Lancé en janvier 2026, l'outil santé d'OpenAI a rapidement séduit des dizaines de millions d'utilisateurs quotidiens, tous en quête de réponses à leurs inquiétudes médicales. Mais la première évaluation de sécurité indépendante, menée par des chercheurs de l'Icahn School of Medicine at Mount Sinai à New York, dresse un portrait glacial de ses capacités. En soumettant 60 scénarios cliniques variés à l'IA, les experts ont comparé ses recommandations à celles d'un consensus de médecins. Le résultat est un échec cuisant, qui soulève de profondes questions sur la régulation de ces technologies algorithmiques.quels sont les dangers les plus graves identifiés par l'étude ?

La faille la plus critique concerne le "sous-triage" des urgences. Face à des symptômes relevant d'une urgence vitale, comme une détresse respiratoire imminente ou une acidocétose diabétique (une complication grave du diabète), l'IA a conseillé dans 52 % des cas de consulter un médecin sous 24 à 48 heures, au lieu d'aller aux urgences immédiatement. Un délai qui peut être fatal.

Pire encore, l'étude montre un comportement paradoxal. Dans un scénario d'asthme sévère, le chatbot identifiait correctement les signes avant-coureurs d'une insuffisance respiratoire... avant de conclure qu'il fallait attendre. L'IA voit le danger, mais le désamorce dans la même phrase par une véritable hallucination algorithmique.

Pire encore, l'étude montre un comportement paradoxal. Dans un scénario d'asthme sévère, le chatbot identifiait correctement les signes avant-coureurs d'une insuffisance respiratoire... avant de conclure qu'il fallait attendre. L'IA voit le danger, mais le désamorce dans la même phrase par une véritable hallucination algorithmique.À l'inverse, elle panique pour un rien : près de 65 % des cas bénins, qui ne nécessitent aucune consultation, ont été orientés à tort vers un médecin ou les urgences, saturant potentiellement le système de santé pour rien.

comment l'IA peut-elle se tromper de manière aussi spectaculaire ?

Les chercheurs pointent plusieurs biais cognitifs alarmants intégrés dans le réseau de neurones. L'un des plus troublants est l'influence sociale. Lorsqu'un proche (simulé dans le scénario) minimisait les symptômes, l'IA devenait presque 12 fois plus susceptible de sous-évaluer la gravité du cas. Elle se laisse influencer. Elle n'analyse pas, elle imite, avec tous les risques de mauvais diagnostic que cela implique.

Le volet le plus glaçant concerne la détection du risque suicidaire. Les "garde-fous", censés afficher un bandeau d'aide en cas de crise, se déclenchent de manière totalement incohérente.

Le volet le plus glaçant concerne la détection du risque suicidaire. Les "garde-fous", censés afficher un bandeau d'aide en cas de crise, se déclenchent de manière totalement incohérente.Un patient évoquant un plan précis avait moins de chances de voir l'alerte qu'un autre restant vague. L'ajout de résultats d'analyses sanguines normales à un scénario de crise faisait même disparaître le bandeau d'aide. Un système de sécurité qui dépend de détails aussi triviaux est, de l'avis des chercheurs, plus dangereux que son absence totale.

cette technologie est-elle prête à conseiller les patients ?

Absolument pas. L'intelligence artificielle générative, aussi avancée soit-elle, ne saisit pas les nuances du langage humain ou le contexte d'une situation médicale. Dans un contexte plus large, elles prouvent d'ailleurs leurs limites au détour de nombreuses "hallucinations algorithmiques". Comme le souligne une étudiante en médecine, un patient qui se dit "étourdi" peut décrire des sensations très différentes (vertige, tête qui tourne, instabilité), chacune orientant vers un diagnostic différent. L'IA, elle, noie l'utilisateur sous une liste de possibilités allant de la déshydratation à la tumeur cérébrale, sans aucune hiérarchisation.

Même OpenAI le concède en petits caractères : son outil n'est "pas destiné au diagnostic ni au traitement". Le problème, c'est que des millions de personnes l'utilisent précisément pour ça.

Même OpenAI le concède en petits caractères : son outil n'est "pas destiné au diagnostic ni au traitement". Le problème, c'est que des millions de personnes l'utilisent précisément pour ça.Ces modèles de langage (LLM) peuvent être utiles pour comprendre une maladie déjà diagnostiquée ou les effets d'un médicament, mais ils ne remplacent en rien un véritable diagnostic médical. L'expertise humaine, la capacité à poser les bonnes questions et à interpréter des signaux faibles, reste indispensable.

Foire aux questions (FAQ)

peut-on faire confiance à chatgpt health pour un avis médical ?

Non. La dernière étude indépendante montre que l'outil est très peu fiable pour évaluer la gravité des symptômes. Il rate plus d'une urgence vitale sur deux et peut donner des conseils dangereux, notamment en cas de risque suicidaire.

que faut-il faire en cas de symptômes inquiétants ?

Il ne faut surtout pas attendre l'avis d'une IA. En cas de symptômes graves comme une douleur thoracique, des difficultés à respirer ou des pensées suicidaires, contactez immédiatement les services d'urgence (le 15 en France) ou un professionnel de santé.

l'IA en santé est-elle donc une mauvaise chose ?

Pas nécessairement. L'IA peut être un outil puissant pour aider les médecins ou pour fournir des informations générales aux patients sur des diagnostics déjà établis. Le danger réside dans son utilisation comme substitut à un médecin pour poser un diagnostic ou décider de la marche à suivre en cas d'urgence.

merci à GNT