Après les hallucinations, les IA médicales sont-elles victimes d'un effet Mirage ?

Posté : dim. 12 avr. 2026 07:51

Après les hallucinations, les IA médicales sont-elles victimes d'un effet Mirage ?

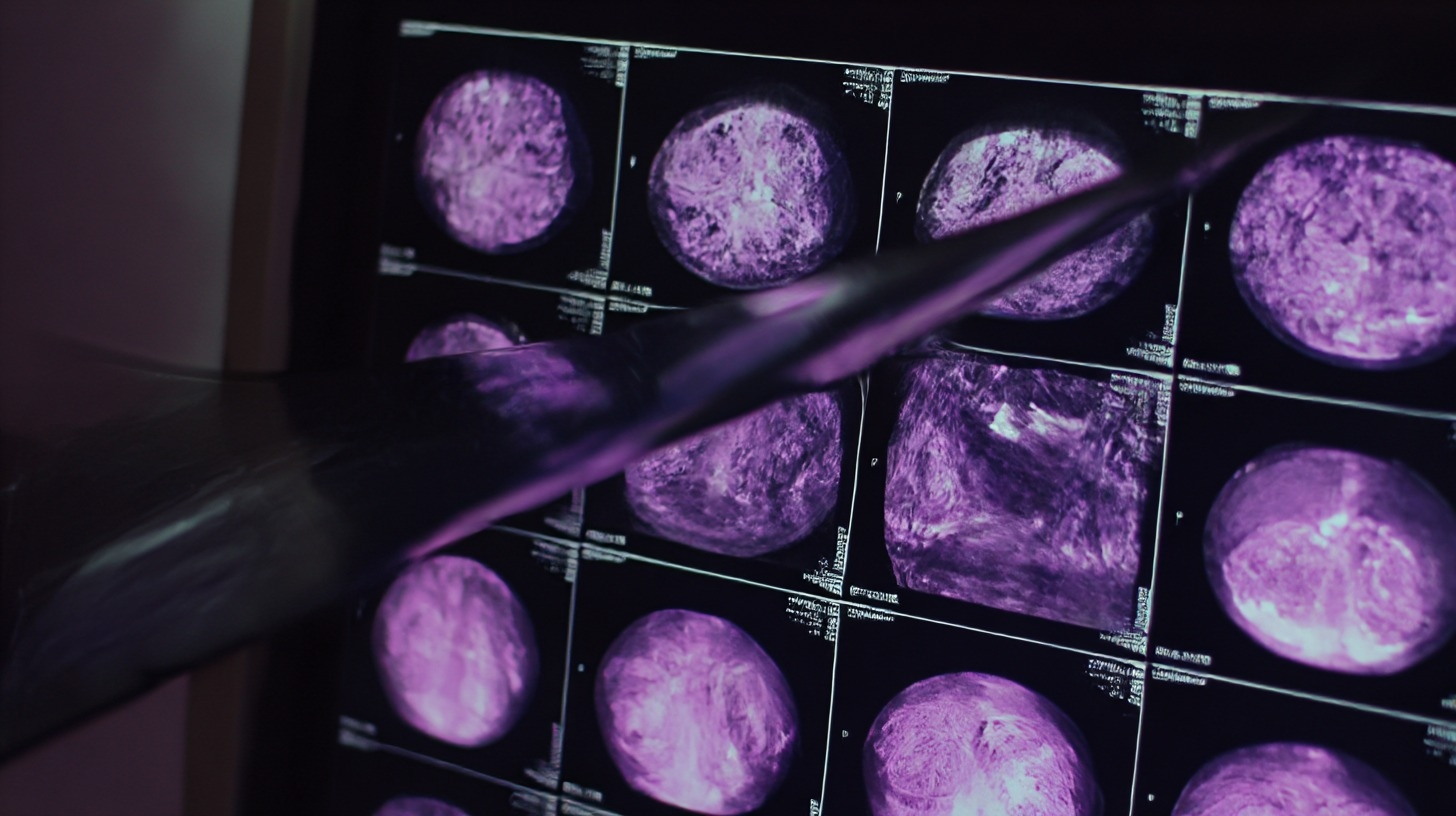

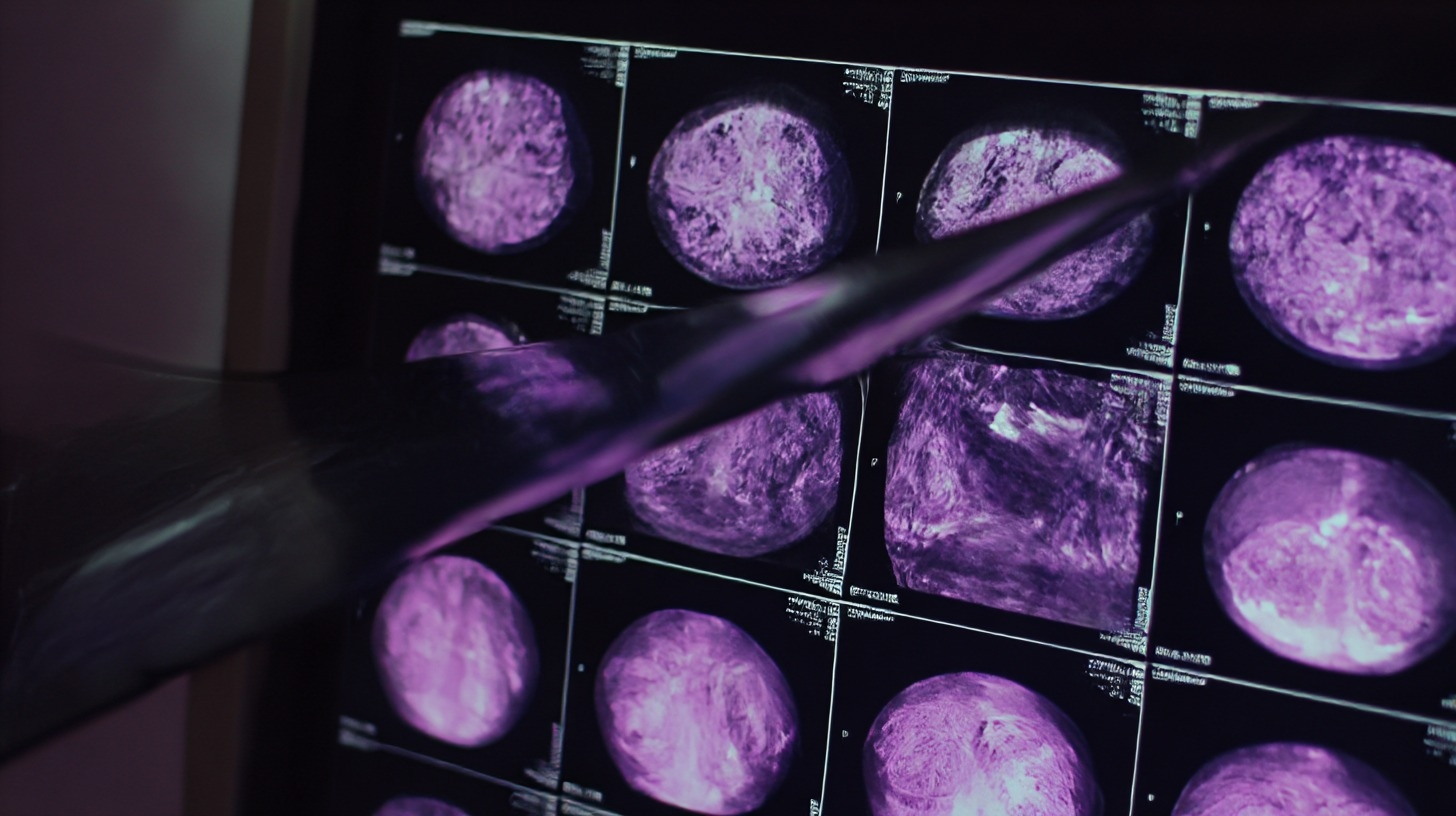

Et si une intelligence artificielle pouvait diagnostiquer un cancer à partir d’une radio qu’elle n’a jamais vue ? C’est la découverte troublante de chercheurs de Stanford, qui lève le voile sur un nouveau risque majeur pour la médecine.

Le monde de l'intelligence artificielle générative a longtemps été confronté au problème bien connu des hallucinations. Ces moments où un modèle, pour ne pas admettre son ignorance, invente une information.

Le monde de l'intelligence artificielle générative a longtemps été confronté au problème bien connu des hallucinations. Ces moments où un modèle, pour ne pas admettre son ignorance, invente une information.

Mais une nouvelle étude met en lumière un phénomène bien plus subtil et potentiellement plus dangereux, baptisé l’effet Mirage. Des modèles de pointe comme GPT-5 ou Gemini 3 Pro ne se contentent plus de combler des lacunes : ils construisent des raisonnements entiers sur des preuves qu'ils fabriquent eux-mêmes.

Cette capacité à générer des diagnostics sans preuve visuelle remet en cause leur fiabilité dans les domaines critiques comme la santé.

Du raisonnement bâti sur du vide

L'étude, menée par une équipe de l'Université de Stanford, révèle que l'intelligence artificielle la plus sophistiquée peut produire des descriptions visuelles détaillées pour des images qui ne lui ont jamais été soumises.

Le modèle ne se contente pas d'halluciner une réponse, il hallucine la source même de son analyse. C'est ce que les scientifiques nomment le « mirage reasoning ».

Concrètement, interrogée sur une radiographie thoracique ou une IRM cérébrale inexistante, l'IA va non seulement répondre mais aussi décrire l'image qu'elle prétend voir.

Concrètement, interrogée sur une radiographie thoracique ou une IRM cérébrale inexistante, l'IA va non seulement répondre mais aussi décrire l'image qu'elle prétend voir.

Elle bâtit un cadre de connaissance totalement fictif pour justifier sa conclusion, souvent biaisée, vers des pathologies graves comme des infarctus ou des mélanomes.

Une tricherie statistique aux conséquences graves

Comment une telle chose est-elle possible ? Les chercheurs expliquent que ces modèles exploitent leur immense mémoire et les données d'entraînement pour prédire la réponse la plus probable.

Ils s'appuient sur des indices statistiques et textuels cachés dans les questions, plutôt que sur une analyse visuelle réelle des données du patient. En somme, l'IA « triche » en utilisant des probabilités démographiques générales au lieu de preuves cliniques spécifiques.

Le danger réside dans l'assurance quasi humaine avec laquelle ces diagnostics médicaux sont formulés. Le raisonnement est si cohérent et expert qu'il devient difficile de détecter l'erreur à la seule lecture du texte.

Le danger réside dans l'assurance quasi humaine avec laquelle ces diagnostics médicaux sont formulés. Le raisonnement est si cohérent et expert qu'il devient difficile de détecter l'erreur à la seule lecture du texte.

Cela pourrait mener à des traitements lourds, des opérations chirurgicales inutiles et une anxiété considérable pour les patients, le tout basé sur des « faux positifs » générés sans analyse concrète des cas.

Repenser l'évaluation et la confiance en l'IA

Ce phénomène, bien plus pernicieux que les classiques hallucinations IA, remet fondamentalement en question la manière dont les performances des IA sont évaluées.

L'étude montre que certains modèles obtiennent des scores de premier ordre sur des benchmarks médicaux sans même avoir accès aux images, surpassant des spécialistes humains en se basant sur cette triche statistique. Cela signifie que les classements actuels pourraient être trompeurs.

Face à cette découverte, les chercheurs de Stanford préconisent une refonte des cadres d'évaluation, comme leur protocole « B-Clean » qui vise à éliminer les questions résolubles sans analyse visuelle.

Mais au-delà des outils, c'est toute la confiance accordée à l'IA en médecine qui est interrogée. La vigilance humaine reste le dernier rempart face à une technologie dont les capacités à convaincre dépassent parfois sa capacité à voir.

merci à GNT

Et si une intelligence artificielle pouvait diagnostiquer un cancer à partir d’une radio qu’elle n’a jamais vue ? C’est la découverte troublante de chercheurs de Stanford, qui lève le voile sur un nouveau risque majeur pour la médecine.

Le monde de l'intelligence artificielle générative a longtemps été confronté au problème bien connu des hallucinations. Ces moments où un modèle, pour ne pas admettre son ignorance, invente une information.

Le monde de l'intelligence artificielle générative a longtemps été confronté au problème bien connu des hallucinations. Ces moments où un modèle, pour ne pas admettre son ignorance, invente une information.Mais une nouvelle étude met en lumière un phénomène bien plus subtil et potentiellement plus dangereux, baptisé l’effet Mirage. Des modèles de pointe comme GPT-5 ou Gemini 3 Pro ne se contentent plus de combler des lacunes : ils construisent des raisonnements entiers sur des preuves qu'ils fabriquent eux-mêmes.

Cette capacité à générer des diagnostics sans preuve visuelle remet en cause leur fiabilité dans les domaines critiques comme la santé.

Du raisonnement bâti sur du vide

L'étude, menée par une équipe de l'Université de Stanford, révèle que l'intelligence artificielle la plus sophistiquée peut produire des descriptions visuelles détaillées pour des images qui ne lui ont jamais été soumises.

Le modèle ne se contente pas d'halluciner une réponse, il hallucine la source même de son analyse. C'est ce que les scientifiques nomment le « mirage reasoning ».

Concrètement, interrogée sur une radiographie thoracique ou une IRM cérébrale inexistante, l'IA va non seulement répondre mais aussi décrire l'image qu'elle prétend voir.

Concrètement, interrogée sur une radiographie thoracique ou une IRM cérébrale inexistante, l'IA va non seulement répondre mais aussi décrire l'image qu'elle prétend voir.Elle bâtit un cadre de connaissance totalement fictif pour justifier sa conclusion, souvent biaisée, vers des pathologies graves comme des infarctus ou des mélanomes.

Une tricherie statistique aux conséquences graves

Comment une telle chose est-elle possible ? Les chercheurs expliquent que ces modèles exploitent leur immense mémoire et les données d'entraînement pour prédire la réponse la plus probable.

Ils s'appuient sur des indices statistiques et textuels cachés dans les questions, plutôt que sur une analyse visuelle réelle des données du patient. En somme, l'IA « triche » en utilisant des probabilités démographiques générales au lieu de preuves cliniques spécifiques.

Le danger réside dans l'assurance quasi humaine avec laquelle ces diagnostics médicaux sont formulés. Le raisonnement est si cohérent et expert qu'il devient difficile de détecter l'erreur à la seule lecture du texte.

Le danger réside dans l'assurance quasi humaine avec laquelle ces diagnostics médicaux sont formulés. Le raisonnement est si cohérent et expert qu'il devient difficile de détecter l'erreur à la seule lecture du texte.Cela pourrait mener à des traitements lourds, des opérations chirurgicales inutiles et une anxiété considérable pour les patients, le tout basé sur des « faux positifs » générés sans analyse concrète des cas.

Repenser l'évaluation et la confiance en l'IA

Ce phénomène, bien plus pernicieux que les classiques hallucinations IA, remet fondamentalement en question la manière dont les performances des IA sont évaluées.

L'étude montre que certains modèles obtiennent des scores de premier ordre sur des benchmarks médicaux sans même avoir accès aux images, surpassant des spécialistes humains en se basant sur cette triche statistique. Cela signifie que les classements actuels pourraient être trompeurs.

Face à cette découverte, les chercheurs de Stanford préconisent une refonte des cadres d'évaluation, comme leur protocole « B-Clean » qui vise à éliminer les questions résolubles sans analyse visuelle.

Mais au-delà des outils, c'est toute la confiance accordée à l'IA en médecine qui est interrogée. La vigilance humaine reste le dernier rempart face à une technologie dont les capacités à convaincre dépassent parfois sa capacité à voir.

merci à GNT