Mistral AI frappe fort avec Mistral Small 4

Posté : mer. 18 mars 2026 08:05

Mistral AI frappe fort avec Mistral Small 4

Toujours sous licence Apache 2.0, Mistral AI agrandit sa famille de modèles Mistrall Small. Mistral Small 4 se pose en solution unifiée des capacités d'autres modèles de la start-up française de l'IA générative.

Mistral AI continue sur sa lancée d'innovations rapides avec l'annonce de Mistral Small 4. Ce nouveau modèle est présenté comme une solution unifiée, fusionnant les capacités de ses modèles phares : Magistral pour le raisonnement, Pixtral pour la multimodalité (texte et image), et Devstral pour le codage agentique.

Mistral AI continue sur sa lancée d'innovations rapides avec l'annonce de Mistral Small 4. Ce nouveau modèle est présenté comme une solution unifiée, fusionnant les capacités de ses modèles phares : Magistral pour le raisonnement, Pixtral pour la multimodalité (texte et image), et Devstral pour le codage agentique.

Quelles sont les caractéristiques de ce modèle ?

Mistral Small 4 repose sur une architecture Mixture-of-Experts (MoE) comptant 128 experts, mais n'en activant que 4 par token pour optimiser l'efficacité. Sur un total de 119 milliards de paramètres, seuls 6 milliards sont actifs lors d'une requête, ce qui permet de maintenir des performances élevées tout en maîtrisant les coûts d'inférence.

Le modèle dispose d'une fenêtre contextuelle de 256 000 tokens et introduit un effort de raisonnement configurable. Les utilisateurs peuvent basculer entre des réponses rapides et légères ou un raisonnement approfondi étape par étape.

Comment se positionne-t-il face à la concurrence ?

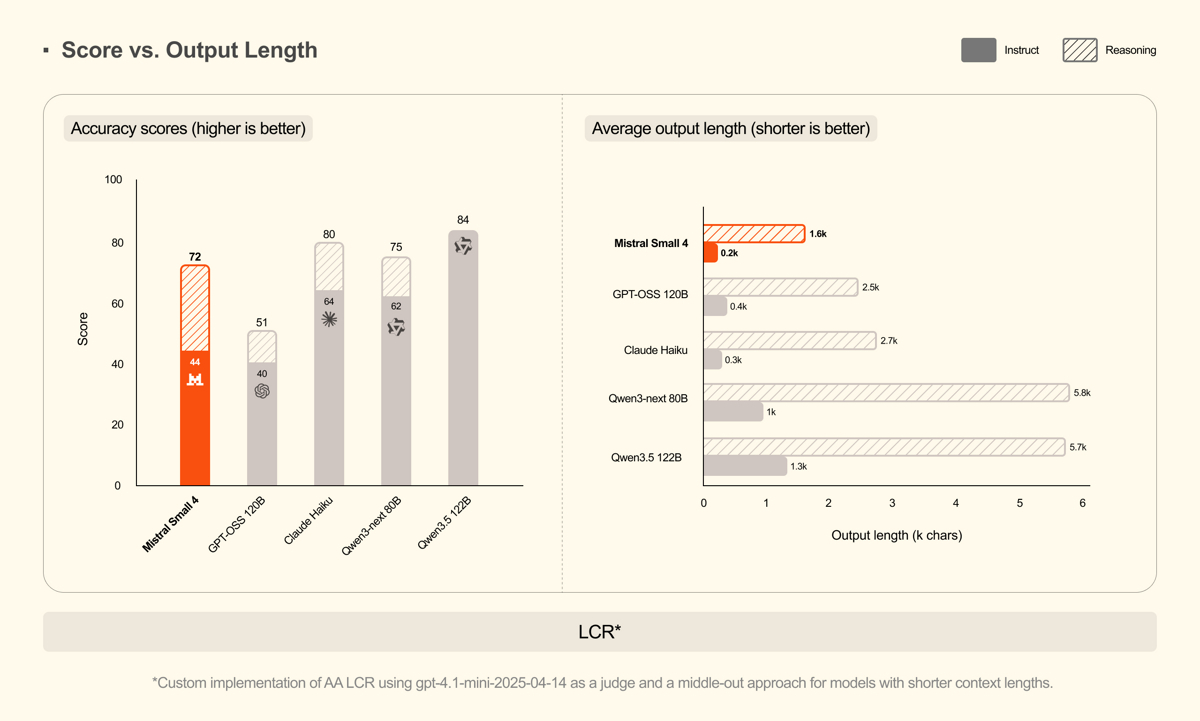

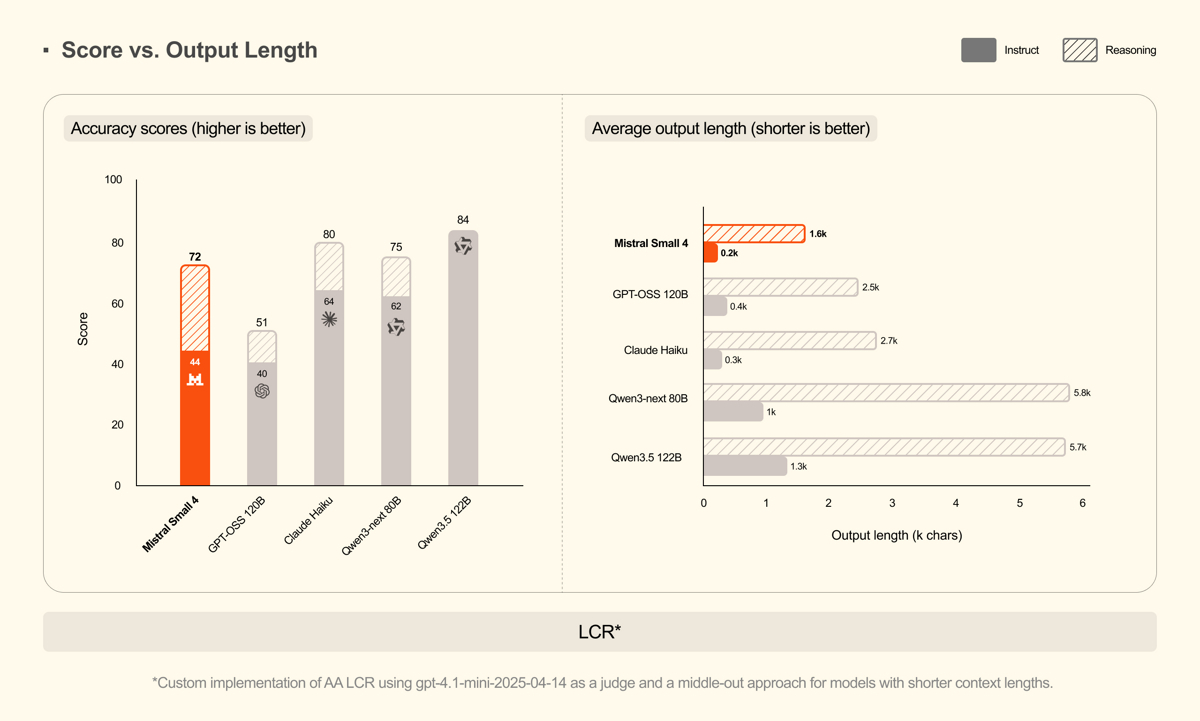

Selon Mistral AI, Mistral Small 4 est 40 % plus rapide en temps de complétion et génère trois fois plus de requêtes par seconde que Mistral Small 3. Dans des benchmarks internes, il atteint des scores égaux ou supérieurs à ceux de gpt-oss-120b, tout en générant des réponses plus courtes.

Cette optimisation est le fruit d'une collaboration étroite avec Nvidia, et Mistral AI est un membre fondateur de la Nemotron Coalition pour promouvoir l'IA ouverte et son prototypage.

Cette optimisation est le fruit d'une collaboration étroite avec Nvidia, et Mistral AI est un membre fondateur de la Nemotron Coalition pour promouvoir l'IA ouverte et son prototypage.

Comment accéder à Mistral Small 4 ?

Mistral AI rend son nouveau modèle largement accessible sous licence Apache 2.0. Les développeurs peuvent d'ores et déjà l'utiliser via l'API Mistral et AI Studio, Hugging Face. Le modèle est aussi disponible en tant que Nvidia NIM.

merci à GNT

Toujours sous licence Apache 2.0, Mistral AI agrandit sa famille de modèles Mistrall Small. Mistral Small 4 se pose en solution unifiée des capacités d'autres modèles de la start-up française de l'IA générative.

Mistral AI continue sur sa lancée d'innovations rapides avec l'annonce de Mistral Small 4. Ce nouveau modèle est présenté comme une solution unifiée, fusionnant les capacités de ses modèles phares : Magistral pour le raisonnement, Pixtral pour la multimodalité (texte et image), et Devstral pour le codage agentique.

Mistral AI continue sur sa lancée d'innovations rapides avec l'annonce de Mistral Small 4. Ce nouveau modèle est présenté comme une solution unifiée, fusionnant les capacités de ses modèles phares : Magistral pour le raisonnement, Pixtral pour la multimodalité (texte et image), et Devstral pour le codage agentique.Quelles sont les caractéristiques de ce modèle ?

Mistral Small 4 repose sur une architecture Mixture-of-Experts (MoE) comptant 128 experts, mais n'en activant que 4 par token pour optimiser l'efficacité. Sur un total de 119 milliards de paramètres, seuls 6 milliards sont actifs lors d'une requête, ce qui permet de maintenir des performances élevées tout en maîtrisant les coûts d'inférence.

Le modèle dispose d'une fenêtre contextuelle de 256 000 tokens et introduit un effort de raisonnement configurable. Les utilisateurs peuvent basculer entre des réponses rapides et légères ou un raisonnement approfondi étape par étape.

Comment se positionne-t-il face à la concurrence ?

Selon Mistral AI, Mistral Small 4 est 40 % plus rapide en temps de complétion et génère trois fois plus de requêtes par seconde que Mistral Small 3. Dans des benchmarks internes, il atteint des scores égaux ou supérieurs à ceux de gpt-oss-120b, tout en générant des réponses plus courtes.

Cette optimisation est le fruit d'une collaboration étroite avec Nvidia, et Mistral AI est un membre fondateur de la Nemotron Coalition pour promouvoir l'IA ouverte et son prototypage.

Cette optimisation est le fruit d'une collaboration étroite avec Nvidia, et Mistral AI est un membre fondateur de la Nemotron Coalition pour promouvoir l'IA ouverte et son prototypage.Comment accéder à Mistral Small 4 ?

Mistral AI rend son nouveau modèle largement accessible sous licence Apache 2.0. Les développeurs peuvent d'ores et déjà l'utiliser via l'API Mistral et AI Studio, Hugging Face. Le modèle est aussi disponible en tant que Nvidia NIM.

merci à GNT